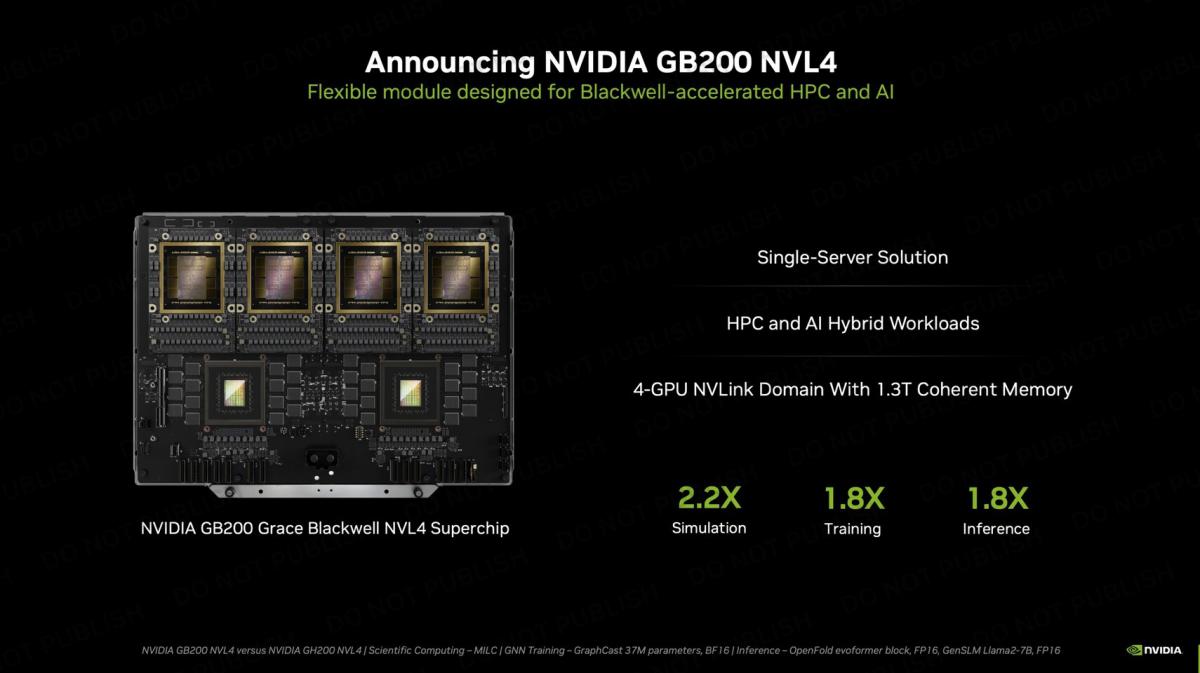

ในงาน SC24 NVIDIA ได้ประกาศเปิดตัวเครื่องเร่งความเร็ว AI ที่มีความหนาแน่นในการคำนวณตัวล่าสุดในรูปแบบของ GB200 NVL4 ซึ่งเป็นโซลูชันเซิร์ฟเวอร์เดี่ยวที่ขยายพอร์ตโฟลิโอซีรีส์ "Blackwell" ของบริษัท แพลตฟอร์มใหม่นี้ประกอบด้วย GPU "Blackwell" สี่ตัวและ CPU "Grace" สองตัวในบอร์ดเดียว GB200 NVL4 มีคุณสมบัติที่โดดเด่นสำหรับระบบเซิร์ฟเวอร์เดี่ยว รวมถึงหน่วยความจำ HBM3E 768 GB ใน GPU Blackwell สี่ตัว ซึ่งมอบแบนด์วิดท์หน่วยความจำรวม 32 TB/s CPU Grace สองตัวของระบบมีหน่วยความจำ LPDDR5X 960 GB ทำให้เป็นกำลังสำคัญสำหรับเวิร์กโหลด AI ที่ต้องการประสิทธิภาพสูง คุณลักษณะสำคัญของการออกแบบ NVL4 คือเทคโนโลยีการเชื่อมต่อ NVLink ซึ่งช่วยให้สามารถสื่อสารระหว่างโปรเซสเซอร์ทั้งหมดบนบอร์ดได้ การผสานรวมนี้มีความสำคัญต่อการรักษาประสิทธิภาพการทำงานที่เหมาะสมที่สุดในหน่วยประมวลผลหลายหน่วยของระบบ โดยเฉพาะอย่างยิ่งในระหว่างการฝึกขนาดใหญ่หรือการอนุมานแบบจำลองพารามิเตอร์หลายล้านล้านตัว

การเปรียบเทียบประสิทธิภาพกับรุ่นก่อนหน้าแสดงให้เห็นถึงการปรับปรุงที่สำคัญ โดย NVIDIA อ้างว่า GPU GB200 ให้ประสิทธิภาพโดยรวมที่เร็วขึ้น 2.2 เท่าและความสามารถในการฝึกอบรมที่เร็วขึ้น 1.8 เท่าเมื่อเทียบกับรุ่นก่อนหน้า GH200 NVL4 ระบบใช้พลังงานได้ถึง 5,400 วัตต์ ซึ่งเพิ่มขึ้นเป็นสองเท่าจากความต้องการ 2,700 วัตต์ของรุ่น GB200 NVL2 ซึ่งเป็นรุ่นน้องที่มี GPU สองตัวแทนที่จะเป็นสี่ตัว NVIDIA กำลังทำงานอย่างใกล้ชิดกับพันธมิตร OEM เพื่อนำโซลูชัน Blackwell ต่างๆ ออกสู่ตลาด รวมถึง DGX B200, GB200 Grace Blackwell Superchip, GB200 Grace Blackwell NVL2, GB200 Grace Blackwell NVL4 และ GB200 Grace Blackwell NVL72 การติดตั้ง TDP 5,400 W ในเซิร์ฟเวอร์เดียวจะต้องใช้การระบายความร้อนด้วยของเหลวเพื่อประสิทธิภาพที่เหมาะสมที่สุด และคาดว่า GB200 NVL4 จะติดตั้งไว้ในแร็คเซิร์ฟเวอร์สำหรับลูกค้าไฮเปอร์สเกลเลอร์ ซึ่งโดยปกติจะมีระบบระบายความร้อนด้วยของเหลวแบบกำหนดเองภายในศูนย์ข้อมูลของตน

ที่มา : TechPowerUp

ที่มา : TechPowerUp