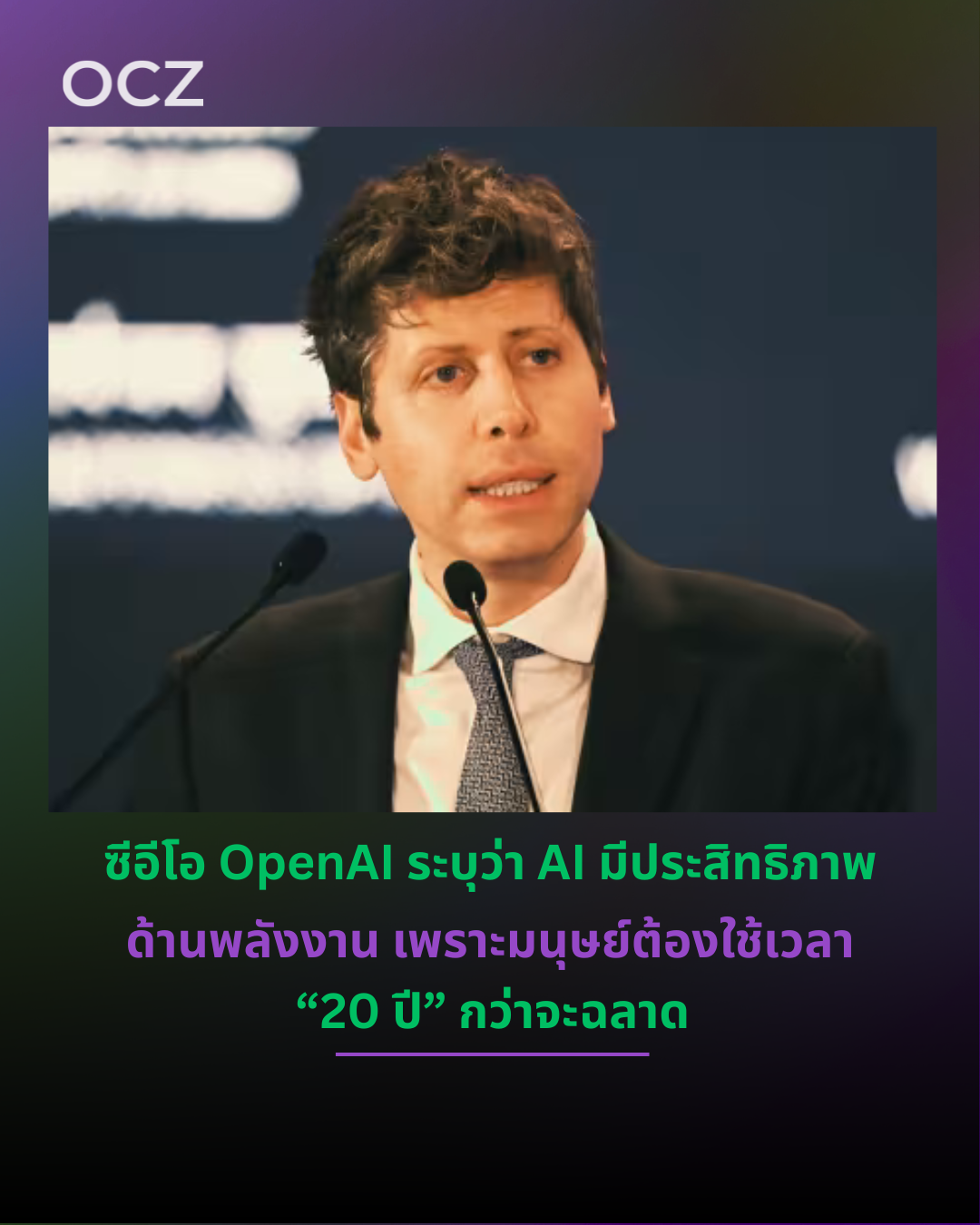

Sam Altman ซีอีโอของ OpenAI ออกมาปกป้องประเด็นการใช้พลังงานสูงของ AI โดยเปรียบเทียบกับพลังงานมหาศาลที่มนุษย์ใช้ตลอดช่วงชีวิตเพื่อเรียนรู้และทำงานต่าง ๆ เขาให้เหตุผลว่า เมื่อโมเดลได้รับการฝึกเสร็จแล้ว AI อย่าง ChatGPT จะมีประสิทธิภาพด้านพลังงานต่อหนึ่งคำถาม (per query) มากกว่ามนุษย์ แม้ต้นทุนพลังงานช่วงฝึก (training) จะสูงมากก็ตาม

ในการให้สัมภาษณ์กับ The Indian Express เมื่อไม่นานมานี้ Altman ถูกถามเกี่ยวกับพลังงานที่ใช้ฝึกโมเดล AI ขนาดใหญ่ ซึ่งกำลังเป็นประเด็นกังวลในหลายประเทศ เนื่องจากการใช้พลังงานของอุตสาหกรรม AI เพิ่มขึ้นอย่างรวดเร็ว จนในบางกรณีศูนย์ข้อมูล (data center) ใช้ไฟมากกว่าทั้งเมืองที่ตั้งอยู่เสียอีก

Altman ระบุว่า การเปรียบเทียบที่หลายคนทำกันนั้น “ไม่ยุติธรรม” เพราะมักเทียบพลังงานที่ใช้ฝึก AI กับพลังงานที่มนุษย์ใช้ตอบคำถามหนึ่งครั้ง เขากล่าวว่า:

“มันก็ใช้พลังงานมากเหมือนกันในการฝึกมนุษย์ ต้องใช้เวลา 20 ปีของชีวิต และอาหารทั้งหมดที่คุณกินในช่วงเวลานั้น ก่อนที่คุณจะฉลาดได้”

เขายังเปรียบเทียบต่อไปว่า หากนับรวมพลังงานทั้งหมดที่มนุษยชาติใช้ตลอดวิวัฒนาการ ตั้งแต่ยุคก่อนประวัติศาสตร์จนถึงการพัฒนาวิทยาศาสตร์และความเข้าใจจักรวาลในปัจจุบันแล้ว AI ก็อาจถือว่ามีประสิทธิภาพมากกว่ามนุษย์โดยรวมในแง่หนึ่ง

อย่างไรก็ตาม มุมมองนี้ถูกมองว่าเป็นการ “เล่นคำ” ทางวาทศิลป์พอสมควร เพราะเป็นการขยายกรอบการเปรียบเทียบจากการใช้พลังงานของดาต้าเซ็นเตอร์ยุคใหม่ ไปสู่พลังงานที่มนุษยชาติใช้ตลอดประวัติศาสตร์ และยังสื่อเหมือนว่าการตอบคำถามหนึ่งครั้งของมนุษย์ต้องอาศัย “พลังงาน 20 ปี” เพื่อให้ได้ผลลัพธ์ ซึ่งถือเป็นการตีความที่ก้าวกระโดดพอสมควร

Altman ยังกล่าวเพิ่มเติมว่า:

“การเปรียบเทียบที่ยุติธรรมคือ ถ้าคุณถาม ChatGPT หนึ่งคำถาม หลังจากโมเดลถูกฝึกแล้ว มันใช้พลังงานเท่าไร เทียบกับมนุษย์ที่ตอบคำถามเดียวกัน ผมคิดว่า AI น่าจะตามทันในแง่ประสิทธิภาพพลังงานแล้ว ถ้าวัดแบบนั้น”

อย่างไรก็ตาม การวัด “แบบนั้น” ดูเหมือนจะนับรวมพลังงานตลอดชีวิตของมนุษย์เข้าไปเป็นต้นทุนการฝึก แต่ไม่ได้รวมต้นทุนพลังงานมหาศาลที่ใช้ฝึกโมเดล AI ตั้งแต่แรกเข้าไปในสมการเดียวกัน จึงทำให้ประเด็นเรื่องพลังงานของ AI ยังคงเป็นหัวข้อถกเถียงต่อไปในวงกว้าง

ที่มา: TweakTown